È come se leggesse i nostri desideri. Senza dover chiedere nulla, lo smartphone ci suggerisce magicamente la pubblicità giusta: ecco l’oggetto di cui parlavate ieri con vostra moglie. Giorni fa dopo aver chiuso una telefonata con un call center, il mio vecchio telefono, che di me sa più di mia madre o di mio marito, mi ha fatto il resoconto scritto della conversazione, offrendosi, senza che glielo avessi chiesto, di aiutarmi a risolvere il problema con la compagnia elettrica. Ebbene sì, qualcuno mi aveva ascoltato.

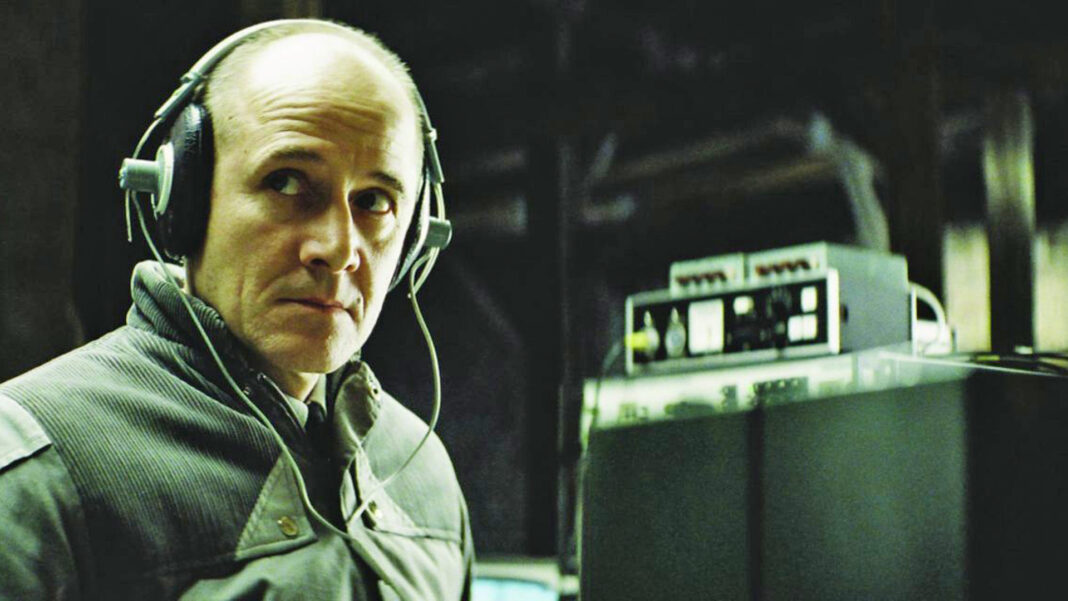

Non un oscuro burocrate con le cuffie, chiuso in un sotterraneo come nel film sulla Ddr degli anni Ottanta, Le vite degli altri (2006). Il mio ascoltatore segreto si chiama Gemini ed è l’Intelligenza artificiale di Google. Probabilmente, nelle tante richieste di autorizzazione che si ripetono durante la navigazione in rete, ho acconsentito involontariamente ed ecco qua l’intruso nella mia vita. Probabilmente anche nelle vostre, perché l’intelligenza artificiale si nutre già delle tracce che lasciamo nelle navigazioni in rete quando regaliamo preziose informazioni su di noi.

Ma la domanda chiave è: come consumatori, siamo ancora liberi di scegliere? Che si chiami Chat Gpt, MidJourney, Gemini, o l’ancora più intelligente Claude – che è usata dal Pentagono per sferrare gli attacchi di missili e droni nelle zone di guerra -, chi comanda è l’algoritmo, un procedimento sistematico informatico che, attraverso un insieme di indicazioni, partendo da una domanda arriva a una risposta. Precisa e sempre più vicina ai nostri pensieri, che l’IA ha imparato a conoscere. Chiariamo: il marketing personalizzato esisteva già e si è rafforzato da quando seminiamo tracce sulla rete, ma con l’IA è infinitamente più semplice e più veloce elaborare dati e proporre soluzioni e pubblicità ad personam.

Il campo del commercio e delle vendite è l’habitat ideale per coltivare queste strategie. Lo spiega l’avvocato Marco Maglio, che dal suo studio legale di Milano si occupa da anni di protezione dei dati personali, diritto del marketing e prevenzione di pratiche commerciali scorrette. Ha anche fondato un network internazionale di giuristi che si chiama Lucerna Iuris per monitorare queste tematiche a difesa dei consumatori.

I pro…

Se quando facciamo acquisti online siamo forse un po’ più consapevoli della nostra vulnerabilità, nella vita fisica come ce la caviamo? Ad esempio in un supermercato cosa succede? «La grande distribuzione è un laboratorio perfetto per l’intelligenza artificiale perché è un contesto dove è facile raccogliere dati da analizzare – spiega l’avvocato -. Si possono usare modelli predittivi per stimare la domanda prodotto per prodotto, negozio per negozio, giorno per giorno. Non è magia, è statistica su scala industriale».

Ogni dato è buono: anche quelli del meteo, per calcolare abitudini dei clienti e propensione alla spesa. Tararsi su queste informazioni per l’impresa significa meno sprechi e meno scaffali vuoti. «Ottimizzazione pura» commenta Maglio. I vantaggi sono innegabili per qualsiasi azienda che si misura con gestioni complesse come quelle dei supermercati. Ma possono ricadere positivamente anche sui clienti perché, riducendo gli sprechi, si possono anche contenere i prezzi alla vendita.

Una delle finalità principali di una cooperativa, il cui scopo non sono i profitti, ma servire i suoi soci.

Altro risvolto positivo dell’IA è la gestione dello spreco alimentare: «Sperimentare modelli che prevedono la deperibilità reale dei freschi in base a rotazione, temperatura e comportamento d’acquisto significa risparmio economico, ma anche minore impatto ambientale».

Per la grande distribuzione un altro ambito di applicazione della IA è quello della logistica, con gli algoritmi che aiutano a gestire le scorte con macchinari e robot che movimentano le merci. «È una coreografia guidata da modelli predittivi» precisa Maglio, e fin qui ancora tutto bene, anche per noi consumatori.

…i contro

Ma a pensar male spesso ci si indovina ed ecco che l’uso dell’intelligenza artificiale da parte delle imprese che vogliono venderci qualcosa può diventare molto meno virtuoso. Alcune usano i dati sui comportamenti dei clienti per indurli all’acquisto, anche se non ne hanno bisogno, stabilendo prezzi di vendita su misura del singolo:

«L’IA applicata all’elasticità della domanda e alla sensibilità al prezzo può suggerire promozioni mirate, costruisce profili probabilistici che stimano cosa potresti comprare la prossima settimana. Una sfera di cristallo statistica». Ecco che le cose cominciano a non tornare per chi compra. L’avvocato Maglio ci racconta che nel mondo anglosassone vengono usati sistemi di “computer vision” per analizzare flussi di clienti, code alle casse, disposizione degli scaffali. In Italia è vietato, ma non si sa mai.

«L’IA può cambiare l’equilibrio informativo tra chi vende e chi compra – aggiunge Maglio -. E quando l’equilibrio si sposta troppo da una parte, emergono rischi legati al fatto che non stiamo parlando solo di automazione. Stiamo parlando di sistemi che osservano, apprendono e influenzano. E quando un sistema impara abbastanza su di te, il rischio non è tecnico. Gli algoritmi non si limitano a suggerire. Ottimizzano la probabilità che tu faccia una determinata scelta. Questo può tradursi in nudging (letteralmente “spinta”) e micro-targeting, offerte costruite per intercettare vulnerabilità specifiche. Il confine tra marketing efficace e sfruttamento psicologico è sottile».

Scogli in vista

Ancora una volta l’avvocato Maglio ci guida in questa traversata in un mare insidioso, indicando gli scogli su cui potremmo naufragare. «Un rischio concreto deriva dalla cosiddetta discriminazione algoritmica: i modelli di apprendimento delle macchine (machine learning models) si formano sui dati storici.

Se quei dati contengono distorsioni sociali o economiche, il sistema può replicarle o amplificarle. Il risultato può essere prezzi diversi, offerte o servizi a condizioni peggiori per determinati profili. Non per volontà esplicita, ma per inferenza statistica».

Poi c’è l’opacità. Molti sistemi di IA sono complessi, talvolta poco spiegabili. Il consumatore potrebbe non sapere che un prezzo, una priorità di assistenza o una proposta contrattuale sono il risultato di un modello predittivo. Senza trasparenza, il diritto di contestare diventa fragile.

Altro punto delicato: la sicurezza. Sistemi di IA integrati con grandi basi di dati sono un obiettivo appetibile per attacchi informatici. Un’intrusione informatica in questo contesto non espone solo dati anagrafici, ma profili comportamentali dettagliati. «Infine, esiste un rischio più ampio: la dipendenza cognitiva. Se le raccomandazioni diventano pervasive, il consumatore può progressivamente delegare scelte. È comodo. Ma ogni delega sistematica riduce l’autonomia decisionale. Non è una distopia, è un effetto graduale».

Secondo l’avvocato Maglio, il vero nodo è la trasparenza: se c’è chiarezza, può esserci anche consapevolezza. Ma come devono essere informati i consumatori, che sono innanzitutto dei cittadini? «Rendere trasparente un algoritmo non significa pubblicare il codice sorgente su internet e sperare che qualcuno lo legga. La vera trasparenza è rendere comprensibile come e perché un sistema prende una decisione che incide su qualcuno. La persona deve sapere che sta interagendo con un sistema automatizzato. Se un prezzo, una priorità o una valutazione sono determinati da un modello, questo va dichiarato in modo chiaro».

Ci pensa l’Europa

Dal prossimo agosto entra definitivamente in vigore il Regolamento europeo sull’IA, che impone responsabilità a chi sviluppa e usa sistemi di questo tipo. Innanzitutto, l’obbligo di dichiarare se ne è stato fatto uso: oggi una miriade di video e testi realizzati con l’IA gira sui canali social e web confondendo verità e finzione.

Anche eventi di estrema gravità come i recenti bombardamenti nell’area mediorientale sono stati elaborati in maniera talmente realistica da sembrare veri, allo scopo di ricostruire i fatti, fra propaganda e sensazionalismo. Il regolamento impone anche la trasparenza degli algoritmi, che devono essere dichiarati nella loro funzionalità e negli obiettivi.

Un primo aiuto, che risulterà certamente prezioso per una popolazione come la nostra che, secondo dati Eurostat 2025, ha competenze digitali di base sotto la media europea (le ha il 54,3% rispetto al 60,4%). Significa cioè che la dimestichezza degli italiani con gli strumenti digitali è davvero minima.

Un sondaggio condotto nel 2025 dalla Modus per Unicoop Firenze ha indagato sul rapporto della popolazione toscana con l’IA. Su circa 750 persone intervistate, il 68% ha dichiarato di conoscere Chat Gpt, ma solo il 46% l’ha usata. Per fare cosa? Principalmente per motivi personali o di lavoro, in particolare per fare ricerche.

Il 46% la considera un’opportunità, mentre per il 31% è una minaccia. Quando viene chiesto se influirà negativamente sui posti di lavoro, risponde sì il 65%. Ed è notizia di qualche settimana fa il licenziamento di 37 lavoratori di una filiale italiana di un’azienda americana che si occupa di software per la finanza: il motivo? Non servono più, ora c’è l’intelligenza artificiale, che pensa per noi.